杭州奧馳會展服務 一站式專業會議解決方案

在當今快節奏的商業環境中,一場成功的會議或展覽活動不僅是信息傳遞的平臺,更是企業形象展示、商務拓展與文化交流的重要窗口。杭州奧馳會展服務有限公司,作為專業的會展服務提供商,致力于為客戶提供從前期策劃到后期執行的全方位、高品質服務,確保每一次活動都精準、高效且令人印象深刻。

核心服務項目

- 會議會場布置與會場規劃:這是活動成功的基礎。奧馳團隊深諳空間美學與功能性的平衡,能夠根據會議主題、規模與客戶需求,進行專業且富有創意的會場規劃與布置。無論是莊重嚴肅的學術報告會、靈動活躍的產品發布會,還是溫馨融洽的客戶答謝會,團隊都能通過舞臺搭建、背景板設計、桌椅擺放、燈光調控及主題裝飾等細節,營造出最契合活動氛圍的現場環境,確保流程順暢,提升與會者的體驗感。

- 專業會議服務:涵蓋活動全流程的精細化服務是奧馳的強項。從最初的方案策劃、日程制定、嘉賓邀請與接待,到現場的注冊簽到、物料管理、流程控場及應急處理,團隊憑借豐富的經驗和嚴謹的態度,確保每一個環節無縫銜接,讓主辦方能夠專注于會議內容本身,無后顧之憂。

- 會議攝影攝像:精彩瞬間的永恒留存至關重要。奧馳配備專業的攝影攝像團隊及高清設備,擅長捕捉演講者的神韻、與會者的互動、現場的熱烈氣氛以及每一個關鍵環節。后期提供高質量的圖片精修與視頻剪輯制作服務,為活動留存珍貴的影音資料,可用于后續宣傳、匯報或品牌素材積累。

- 會議旅游:針對有異地嘉賓或希望結合團隊建設需求的會議,奧馳可提供定制化的會議旅游服務。依托杭州得天獨厚的自然與人文景觀,設計多條精品線路,將專業的會務安排與愜意的旅游體驗相結合,促進交流,深化關系,讓商務旅程更加豐富和難忘。

- 會議音響租賃:清晰、穩定、富有感染力的音響效果是會議信息有效傳達的保障。奧馳提供各類專業級音響、話筒、調音臺及同聲傳譯設備的租賃與服務,并由經驗豐富的音響師現場調控,確保無論場地大小,聲音都能均勻覆蓋、清晰悅耳,完美支持演講、討論、演出等各類環節。

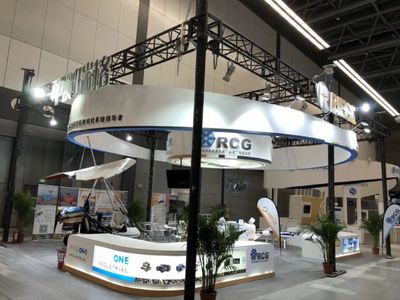

- 綜合會議及展覽服務:除了專項服務,奧馳更提供全面的會議及展覽解決方案。這包括展覽展臺的設計與搭建、展品運輸與倉儲、活動物料制作、線上直播技術支持、媒體合作以及整體活動品牌包裝等。公司能夠靈活整合資源,為客戶量身打造集策劃、設計、運營、推廣于一體的整合性會展項目。

為何選擇杭州奧馳?

- 本地化深度服務:扎根杭州,深刻理解本地市場與文化,擁有廣泛的場地及供應商資源網絡,響應迅速。

- 一站式省心體驗:整合多項服務,提供“交鑰匙”工程,客戶只需對接一個團隊,即可統籌全局,極大提升溝通效率,降低成本與復雜度。

- 專業團隊保障:擁有經驗豐富的策劃、設計、執行及技術團隊,以專業素養和匠心精神對待每一個項目細節。

- 創意與執行并重:在追求方案創新與視覺沖擊力的更注重落地的可行性與執行的嚴謹性,確保創意完美呈現。

杭州奧馳會展服務,以專業鑄就品質,以服務贏得信賴。無論是高端國際論壇、大型行業峰會,還是精致的企業年會、產品推廣展,奧馳都將是您值得托付的合作伙伴,共同打造卓越、成功的會展體驗。

如若轉載,請注明出處:http://www.hneed.cn/product/6.html

更新時間:2026-05-11 21:18:46